Lockdown mode και ετικέτες «Αυξημένου Κινδύνου»

Καθώς τα συστήματα AI αναλαμβάνουν ολοένα πιο σύνθετες εργασίες που «ακουμπάνε» διαδίκτυο και συνδεδεμένες εφαρμογές, η OpenAI ανακοίνωσε μια νέα δέσμη μέτρων ασφαλείας για το ChatGPT.

Στο επίκεντρο βρίσκεται ο κίνδυνος των επιθέσεων τύπου prompt injection, όπου κακόβουλοι τρίτοι προσπαθούν να παραπλανήσουν το μοντέλο προκειμένου να ακολουθήσει κακόβουλες οδηγίες ή να αποκαλύψει ευαίσθητες πληροφορίες.

Το πρώτο μέτρο είναι το Lockdown Mode: μια προαιρετική, προηγμένη ρύθμιση για χρήστες και οργανισμούς υψηλού ρίσκου (π.χ. στελέχη επιχειρήσεων, developers, ομάδες ασφάλειας). Όταν ενεργοποιείται, περιορίζει αυστηρά την αλληλεπίδραση του ChatGPT με εξωτερικά συστήματα (sandboxing) και απενεργοποιεί συγκεκριμένα εργαλεία/δυνατότητες που θα μπορούσαν να αξιοποιηθούν για εξαγωγή δεδομένων. Ενδεικτικά, η περιήγηση στον ιστό περιορίζεται σε περιεχόμενο από cache, ώστε να μην φεύγουν «ζωντανά» αιτήματα δικτύου εκτός του ελεγχόμενου περιβάλλοντος. Η λειτουργία είναι διαθέσιμη σε ChatGPT Enterprise, Edu, for Healthcare και for Teachers, με ενεργοποίηση από τους διαχειριστές, ενώ η OpenAI λέει πως θα τη φέρει τη συγκεκριμένη λειτουργία και στους καταναλωτές τους επόμενους μήνες.

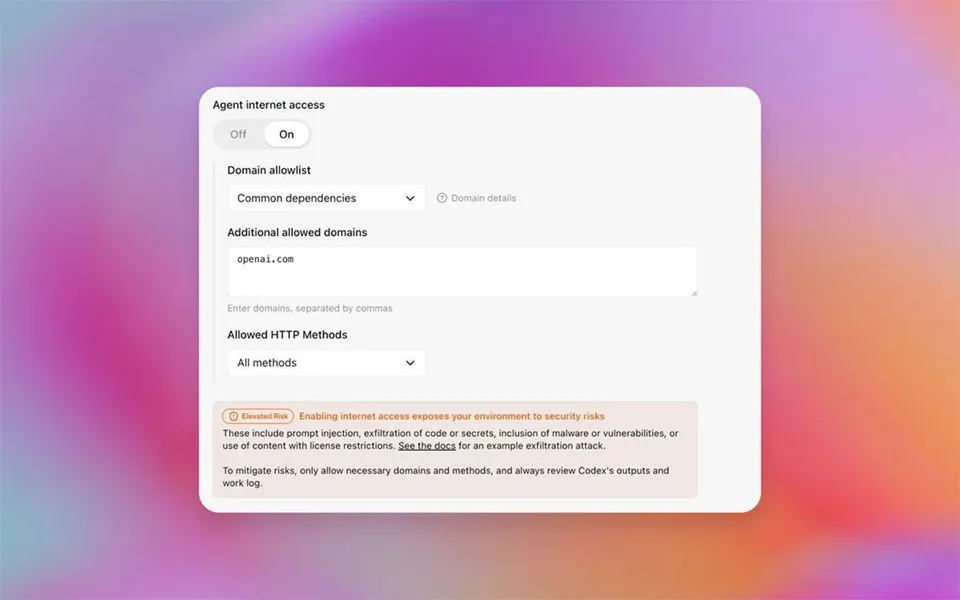

Το δεύτερο μέτρο είναι η νέες ετικέτες «Αυξημένου κινδύνου» (Elevated Risk) που προειδοποιούν τον χρήστη όταν χρησιμοποιεί λειτουργίες που ενδέχεται να εκθέσουν προσωπικά δεδομένα – π.χ. όταν δίνει στο Codex πρόσβαση στο δίκτυο. Αυτές οι κινήσεις δείχνουν πως η OpenAI αντιμετωπίζει πλέον πιο σοβαρά το θέμα της ασφάλειας και της προστασίας της ιδιωτικότητας. Και ακόμα και αν το Lockdown Mode μοιάζει υπερβολικό για το μέσο χρήστη, αποτελεί μια απαραίτητη «ζώνη ασφαλείας» στον κόσμο της Τεχνητής Νοημοσύνης, για όσους διαχειρίζονται κρίσιμες πληροφορίες.

Πηγή:neolaia.gr